IL BAGLIORE CHE NON SVANISCE.

Fotografia e memoria del trauma nucleare in Giappone, 80 anni dopo.

di Filippo Venturi, 26/08/2025.

In Europa, la Seconda guerra mondiale terminò l’8 maggio 1945 con la resa della Germania, ma nel Pacifico il conflitto proseguì in modo sanguinoso. Il Giappone, infatti, non contemplava la sconfitta e si preparava a una resistenza a oltranza contro gli attacchi degli americani.

Il 16 luglio 1945, con l’esito positivo del test Trinity, condotto nel deserto del New Mexico nell’ambito del Progetto Manhattan, gli Stati Uniti divennero i primi possessori dell’arma atomica funzionante. In breve tempo, questa nuova bomba fu considerata lo strumento con cui accelerare la conclusione del conflitto: avrebbe dovuto causare una tale distruzione da spezzare anche l’orgoglio giapponese e costringere il paese alla resa.

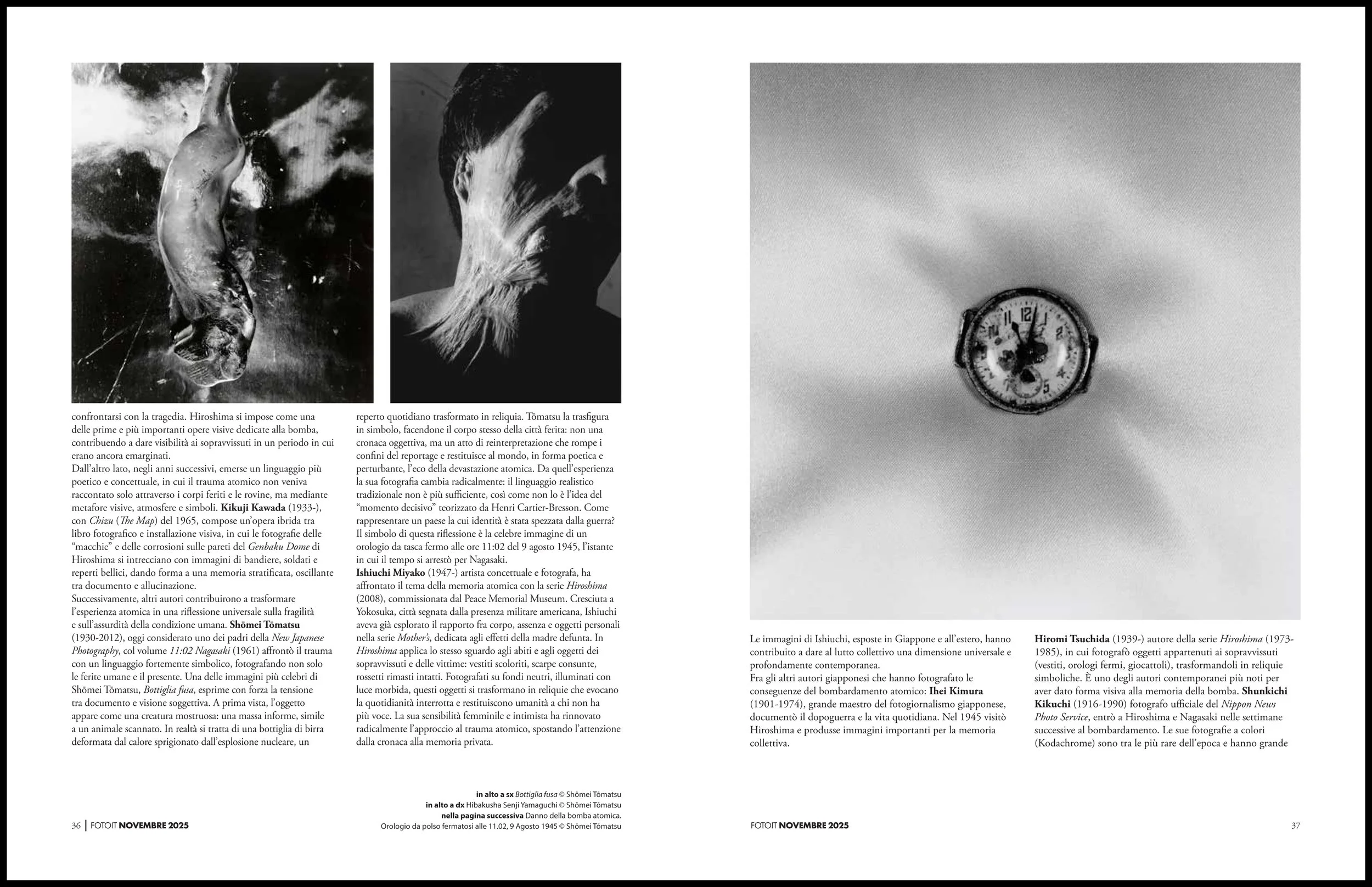

Il 6 agosto, alle ore 8.15, la bomba all’uranio Little Boy venne sganciata su Hiroshima (l’esplosione avvenne a un’altezza di circa 580 metri dal suolo) provocando la morte immediata di decine di migliaia di persone — il bilancio totale delle vittime, incluse quelle decedute successivamente per ustioni e radiazioni, è stimato in 140.000. Il 9 agosto, alle ore 11.02, la bomba al plutonio Fat Man colpì Nagasaki, causando complessivamente circa 70-80.000 morti.

Neppure dopo queste ecatombi i vertici militari giapponesi accettarono la sconfitta. Si rese quindi necessario l’intervento personale dell’imperatore Hirohito che — rompendo con la tradizione che lo voleva figura sacra e distante — si rivolse per la prima volta direttamente alla nazione, pronunciando il 15 agosto 1945 un discorso radiofonico per annunciare la cessazione delle ostilità e salvare il Giappone dalla completa distruzione. Il 2 settembre 1945, infine, venne firmato l’atto di resa a bordo della nave da guerra USS Missouri, nella baia di Tokyo.

———

Il trauma atomico del 1945 segnò profondamente l’identità culturale del Giappone e si riflesse con forza nella sua produzione artistica, dando origine a una lunga e dolorosa elaborazione collettiva. L’esperienza apocalittica di Hiroshima e Nagasaki, unita allo shock per la resa e la fine dell’imperialismo, generò un senso diffuso di lutto, vergogna e riflessione esistenziale, che si tradusse in una ricerca di nuove forme espressive capaci di affrontare l’irrappresentabile e di dare voce all’angoscia di un’intera nazione.

L’immaginario collettivo fu segnato da simboli indelebili — il fungo atomico, le ombre impresse sui muri, i corpi devastati — che tornarono ciclicamente nelle opere letterarie, cinematografiche e fotografiche. Persino generazioni successive, che non avevano vissuto direttamente il trauma, sentirono il bisogno di confrontarsi con quell’eredità. Questo impulso ha alimentato un filone che potremmo definire post-atomico, in cui l’eco della bomba continua a risuonare come spunto per riflessioni più ampie sull’identità nazionale, sulla fragilità dell’esistenza e sui pericoli della modernità.

La fotografia giapponese, in particolare, divenne uno strumento privilegiato di memoria e testimonianza: inizialmente documentaria e cruda — come nelle immagini dei sopravvissuti irradiati o delle città rase al suolo — si evolse verso linguaggi più concettuali, poetici e sperimentali, nel tentativo di restituire dignità a ciò che era stato annientato e di interrogarsi sul futuro.

———

Nei giorni immediatamente successivi al bombardamento, alcuni fotografi iniziarono a documentare le rovine e le vittime. Tra i primi testimoni vi fu Yōsuke Yamahata (1917-1966), che il 10 agosto 1945 — appena un giorno dopo l’attacco a Nagasaki — girò la città realizzando oltre cento fotografie. Il suo lavoro rappresenta uno dei reportage più completi e sistematici su una città colpita da un’arma nucleare e offre una testimonianza unica per ampiezza e immediatezza. Le immagini di Yamahata mostrano scene di distruzione totale, ma anche la quotidianità spezzata dei sopravvissuti: corpi bruciati, edifici rasi al suolo, uomini e donne in cerca di cure o di acqua, famiglie che vegliano i loro morti. Lo sguardo del fotografo alterna vedute panoramiche a dettagli ravvicinati, restituendo tanto l’impatto della catastrofe sull’intera città quanto la sofferenza individuale. Yamahata si è spento all’età di 48 anni, a causa di un tumore, possibile conseguenza della sua permanenza a Nagasaki.

Yoshito Matsushige (1913-2005) fu l’unico fotografo a documentare Hiroshima subito dopo l’esplosione atomica. Con la sua macchina fotografica riuscì a scattare appena cinque immagini, tra cui quelle sul ponte Miyuki, dove studenti ustionati e poliziotti feriti cercavano soccorso. Quelle fotografie, che mostrano corpi scorticati e scene di disperazione, sono diventate l’unica testimonianza visiva diretta del bombardamento in quello stesso giorno. Matsushige stesso visse a lungo con il senso di colpa: da un lato per aver ritratto i propri concittadini in uno stato di tale sofferenza, dall’altro per non aver avuto la forza di documentare di più.

Il 18 agosto 1945 il Consiglio di Ricerca Scientifica del Giappone istituì la Special Committee for the Investigation of the Effects of the Atomic Bomb con lo scopo di raccogliere, classificare e analizzare dati scientifici, medici e tecnici sugli effetti delle bombe atomiche di Hiroshima e Nagasaki. Il comitato era diviso in sottogruppi disciplinari (fisica, chimica, medicina, geologia, ingegneria, ecc.) e operò fino al 1951, impiegando anche fotografi per documentare i danni, fra cui Shigeo Hayashi (1918-2002), un giovane fotografo dell’Imperial Japanese Army’s Photography Unit, incaricato dalla Commissione Speciale e poi dal Scientific Defense Investigation Group statunitense di realizzare immagini a Hiroshima e Nagasaki. Le sue fotografie (edifici distrutti, resti umani, effetti delle radiazioni) costituiscono alcune delle più complete testimonianze dell’epoca.

Altri fotografi, inclusi quelli delle Università di Tokyo, Kyoto e Hiroshima, furono coinvolti in campagne di rilievo, anche se spesso i loro negativi vennero requisiti dall’esercito americano nell’ambito della censura. La diffusione di queste immagini infatti fu ostacolata per anni.

Durante l’Occupazione americana (1945-1952) entrò in vigore una censura sistematica, che non riguardava solo la stampa giapponese ma anche la circolazione di fotografie e filmati legati alle bombe. Il Civil Censorship Detachment, organo istituito dal Comando Supremo delle Forze Alleate, proibì la pubblicazione di qualunque materiale che potesse suscitare compassione verso le vittime, fomentare sentimenti antiamericani o mettere in discussione la decisione di utilizzare l’arma atomica. Fotografie e rapporti vennero requisiti e archiviati; molte immagini rimasero inedite fino agli anni Cinquanta, quando il trattato di San Francisco sancì la fine dell’occupazione e il Giappone riacquistò la sovranità. L’immaginario della popolazione americana era dominato dall’iconica nuvola a fungo, mentre mancava la percezione della sofferenza umana diretta. La produzione fotografica americana fu legata soprattutto a scopi militari, scientifici o propagandistici. Le immagini del U.S. Strategic Bombing Survey e quelle dell’Atomic Bomb Casualty Commission documentavano rispettivamente i danni alle infrastrutture e gli effetti medici delle radiazioni, riducendo spesso la tragedia a un insieme di dati tecnici. Joe O’Donnell (1922-2007) rappresentò un’eccezione: le sue fotografie dei bambini sopravvissuti a Nagasaki, rimaste a lungo inedite, restano fra le rare testimonianze occidentali capaci di restituire la dimensione umana del disastro.

Anche il governo giapponese, piegato dalla sconfitta e impegnato a ricostruire il Paese, non incoraggiò una diffusione immediata di queste testimonianze. La narrazione ufficiale, soprattutto nei primi anni, privilegiava il mito della rinascita e della modernizzazione, relegando le vittime atomiche (hibakusha) a una condizione marginale, spesso segnata da stigma e discriminazioni. Molti superstiti, in particolare donne, venivano rifiutati ed emarginati perché ritenuti “impuri” o “geneticamente compromessi”, con il timore che potessero trasmettere malformazioni congenite o malattie ereditarie ai figli. Non solo nella sfera matrimoniale, ma anche in quella lavorativa e in generale a livello sociale, erano spesso trattati come “esseri umani di serie B”. Solo a partire dagli anni Sessanta si assistette a un progressivo riconoscimento della loro memoria e alla diffusione di una documentazione più ampia.

———

Sul piano artistico, la fotografia giapponese seguì due direzioni. Da un lato rimase il filone documentario, volto a preservare la memoria visiva delle distruzioni. Ken Domon (1909-1990), uno dei maestri del realismo fotografico giapponese, ne fu il rappresentante più autorevole. Dopo aver raggiunto la notorietà come fotoreporter per la rivista Nippon, Domon sviluppò una concezione etica della fotografia, basata sulla “registrazione pura”, cioè la necessità di mostrare la realtà senza abbellimenti né artifici. Il progetto Hiroshima (1958), realizzato tredici anni dopo la bomba, raccoglie ritratti di hibakusha segnati da cicatrici, deformazioni e ustioni, accostati a immagini di rovine e memoriali. Non c’è ricerca di estetica formale, ma l’intento di restituire dignità alle vittime attraverso la loro semplice presenza e di costringere lo spettatore a confrontarsi con la tragedia. Hiroshima si impose come una delle prime e più importanti opere visive dedicate alla bomba, contribuendo a dare visibilità ai sopravvissuti in un periodo in cui erano ancora emarginati.

Dall’altro lato, negli anni successivi, emerse un linguaggio più poetico e concettuale, in cui il trauma atomico non veniva raccontato solo attraverso i corpi feriti e le rovine, ma mediante metafore visive, atmosfere e simboli. Kikuji Kawada (1933-), con Chizu (The Map) del 1965, compose un’opera ibrida tra libro fotografico e installazione visiva, in cui le fotografie delle “macchie” e delle corrosioni sulle pareti del Genbaku Dome di Hiroshima si intrecciano con immagini di bandiere, soldati e reperti bellici, dando forma a una memoria stratificata, oscillante tra documento e allucinazione.

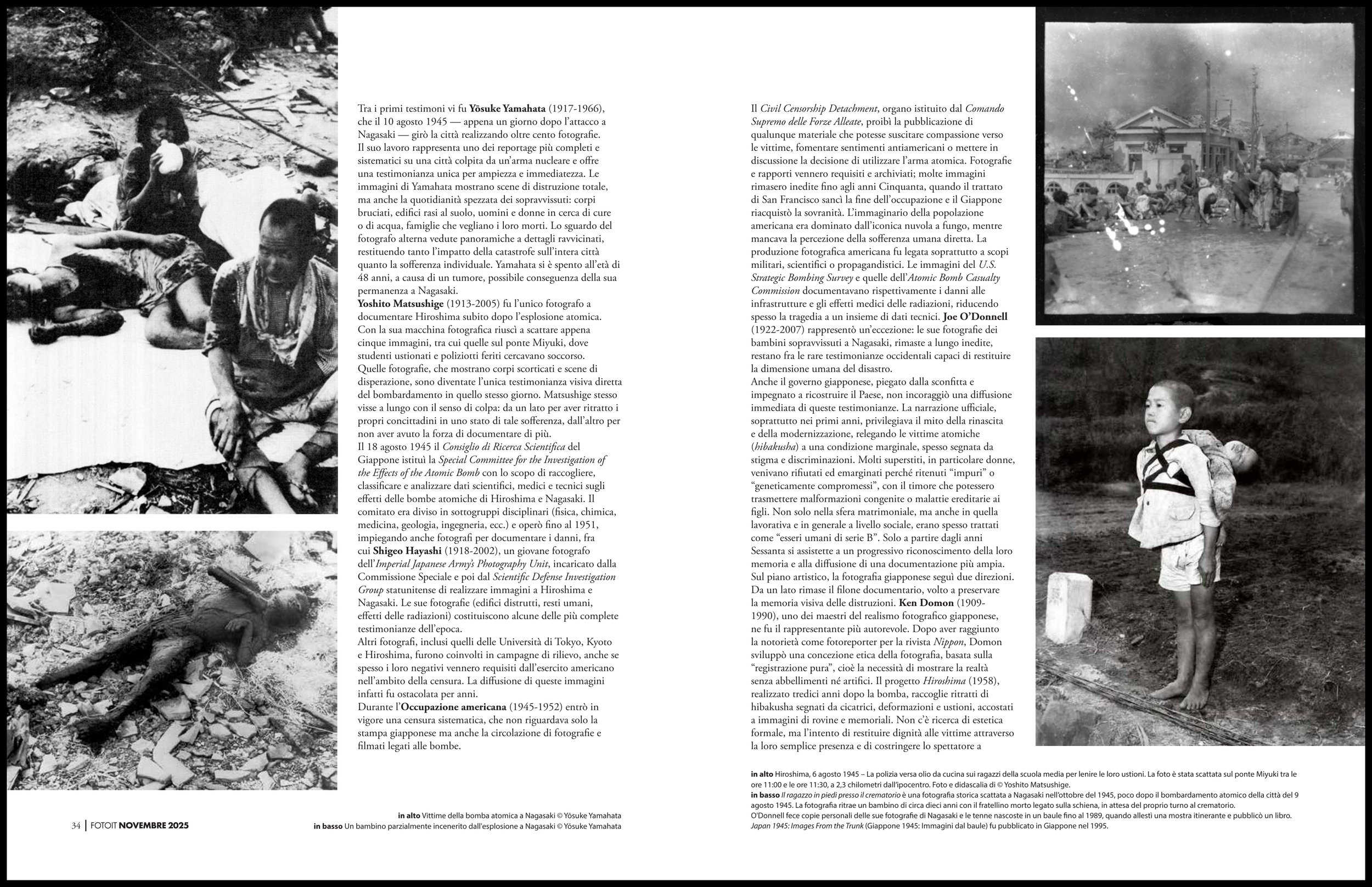

Successivamente, altri autori contribuirono a trasformare l’esperienza atomica in una riflessione universale sulla fragilità e sull’assurdità della condizione umana. Shōmei Tōmatsu (1930-2012), oggi considerato uno dei padri della New Japanese Photography, col volume 11:02 Nagasaki (1961) affrontò il trauma con un linguaggio fortemente simbolico, fotografando non solo le ferite umane e il presente. Una delle immagini più celebri di Shōmei Tōmatsu, Bottiglia fusa, esprime con forza la tensione tra documento e visione soggettiva. A prima vista, l’oggetto appare come una creatura mostruosa: una massa informe, simile a un animale scannato. In realtà si tratta di una bottiglia di birra deformata dal calore sprigionato dall’esplosione nucleare, un reperto quotidiano trasformato in reliquia. Tōmatsu la trasfigura in simbolo, facendone il corpo stesso della città ferita: non una cronaca oggettiva, ma un atto di reinterpretazione che rompe i confini del reportage e restituisce al mondo, in forma poetica e perturbante, l’eco della devastazione atomica. Da quell’esperienza la sua fotografia cambia radicalmente: il linguaggio realistico tradizionale non è più sufficiente, così come non lo è l’idea del “momento decisivo” teorizzato da Henri Cartier-Bresson. Come rappresentare un paese la cui identità è stata spezzata dalla guerra? Il simbolo di questa riflessione è la celebre immagine di un orologio da tasca fermo alle ore 11:02 del 9 agosto 1945, l’istante in cui il tempo si arrestò per Nagasaki.

Ishiuchi Miyako (1947-) artista concettuale e fotografa, ha affrontato il tema della memoria atomica con la serie Hiroshima (2008), commissionata dal Peace Memorial Museum. Cresciuta a Yokosuka, città segnata dalla presenza militare americana, Ishiuchi aveva già esplorato il rapporto fra corpo, assenza e oggetti personali nella serie Mother’s, dedicata agli effetti della madre defunta. In Hiroshima applica lo stesso sguardo agli abiti e agli oggetti dei sopravvissuti e delle vittime: vestiti scoloriti, scarpe consunte, rossetti rimasti intatti. Fotografati su fondi neutri, illuminati con luce morbida, questi oggetti si trasformano in reliquie che evocano la quotidianità interrotta e restituiscono umanità a chi non ha più voce. La sua sensibilità femminile e intimista ha rinnovato radicalmente l’approccio al trauma atomico, spostando l’attenzione dalla cronaca alla memoria privata. Le immagini di Ishiuchi, esposte in Giappone e all’estero, hanno contribuito a dare al lutto collettivo una dimensione universale e profondamente contemporanea.

Fra gli altri autori giapponesi che hanno fotografato le conseguenze del bombardamento atomico: Ihei Kimura (1901-1974), grande maestro del fotogiornalismo giapponese, documentò il dopoguerra e la vita quotidiana. Nel 1945 visitò Hiroshima e produsse immagini importanti per la memoria collettiva. Hiromi Tsuchida (1939-) autore della serie Hiroshima (1973-1985), in cui fotografò oggetti appartenuti ai sopravvissuti (vestiti, orologi fermi, giocattoli), trasformandoli in reliquie simboliche. È uno degli autori contemporanei più noti per aver dato forma visiva alla memoria della bomba. Shunkichi Kikuchi (1916-1990) fotografo ufficiale del Nippon News Photo Service, entrò a Hiroshima e Nagasaki nelle settimane successive al bombardamento. Le sue fotografie a colori (Kodachrome) sono tra le più rare dell’epoca e hanno grande valore documentario. Eiichi Matsumoto (1915-2004), fotogiornalista dell’Asahi Shimbun, visitò Hiroshima e Nagasaki nel settembre 1945 per documentare la devastazione. Le sue immagini furono immediatamente sottoposte a censura dall’Occupazione americana e non poterono essere pubblicate fino al 1952, quando la rivista Asahi Graph dedicò un numero speciale agli attacchi atomici. Quelle fotografie, rimaste nascoste per anni, sono oggi considerate testimonianze fondamentali. Chikuma Kobayashi (1920-1991) reporter dell’Asahi Shimbun, realizzò reportage sulle distruzioni atomiche e sul dramma degli hibakusha durante gli anni ’50, contribuendo a portare le loro storie su scala nazionale.

———

Susan Sontag, nel saggio Regarding the Pain of Others, avvertiva del rischio di assuefazione visiva: quando le immagini dell’orrore vengono ripetute e riprodotte senza sosta, possono perdere la capacità di smuovere la coscienza, trasformandosi in una sequenza di scene già viste. Proprio contro questa anestesia dello sguardo hanno lavorato molti fotografi giapponesi, sperimentando linguaggi visivi capaci di spezzare l’abitudine e costringere lo spettatore a un confronto autentico e insostenibile con la distruzione atomica. In questo senso, il realismo etico di Ken Domon, la tensione simbolica di Shōmei Tōmatsu e l’approccio intimista di Ishiuchi Miyako rappresentano tre declinazioni diverse di una stessa esigenza: opporsi alla banalizzazione e alla ripetizione del trauma.

Parallelamente, studi storici come quelli di John Dower e Lisa Yoneyama hanno mostrato come la memoria atomica sia stata terreno di tensione e conflitto tra narrazione ufficiale e ricordi privati. Dower, in Embracing Defeat, ha messo in luce come l’Occupazione americana abbia modellato dall’alto la memoria collettiva, imponendo una censura minuziosa, oscurando per anni le immagini delle vittime e privilegiando un discorso pubblico orientato alla modernizzazione e alla rinascita del Giappone, più che al lutto. Yoneyama, in Hiroshima Traces, ha invece analizzato le “memorie dissonanti”: quelle voci marginali — dei superstiti, delle donne, degli attivisti — che non coincidevano con la memoria nazionale dominante, ma che attraverso la fotografia, la letteratura e le pratiche commemorative sono riuscite a riemergere e a mettere in discussione il silenzio imposto. Ne deriva un quadro complesso, in cui la fotografia non è soltanto documento storico, ma mezzo di resistenza della memoria: tra la volontà di rimuovere l’orrore per favorire la ricostruzione e il bisogno di ricordare per dare dignità a chi era stato ridotto all’oblio.

———

Questo doppio registro, realistico e visionario, ha continuato a caratterizzare la fotografia giapponese anche nelle generazioni successive: da un lato, la necessità di preservare la testimonianza diretta dei sopravvissuti; dall’altro, la spinta a reinventare i linguaggi visivi per dare voce a un trauma che, pur lontano nel tempo, continua a riverberare nella coscienza collettiva del Giappone.

A ottant’anni dalle esplosioni di Hiroshima e Nagasaki, quelle immagini parlano ancora all’oggi. In un mondo in cui il rischio di conflitti atomici torna a riaffacciarsi e in cui la tecnologia avanza con una velocità che spesso supera la capacità di regolamentarla, la memoria del trauma nucleare diventa uno specchio del presente. Le fotografie dei bombardamenti non sono soltanto archivi del dolore passato, ma avvertimenti per il futuro: mostrano cosa accade quando la scienza e il potere si alleano senza limiti etici. Per questo la loro forza non si esaurisce nella commemorazione, ma continua a interrogarci sulla responsabilità collettiva di fronte a nuove forme di minaccia globale. La fotografia restituisce così al presente il bagliore che non svanisce: quello di una luce che annientò tutto e che, proprio per questo, obbliga a ricordare.